眼睑和学生具有里程碑意义的检测和眨眼估计基于可变形形状模型对近红外视频gydF4y2Ba

- 1gydF4y2Ba学院的电气工程和电信、新南威尔士大学、悉尼新南威尔士、澳大利亚gydF4y2Ba

- 2gydF4y2BaCSIRO Data61,悉尼,澳大利亚新南威尔士州gydF4y2Ba

眼睑轮廓,瞳孔轮廓,眨眼睛活动的事件是很重要的特性,以及他们的估计是基于摄像头的关键研究领域新兴的可穿戴眼镜在范围广泛的应用程序例如,精神状态估计。当前方法通常估计单个眼睛活动,如眨眼或瞳孔中心,从远场和non-infrared (IR)眼图像,并且经常取决于另一只眼睛组件的知识。提出了一个统一的方法来同时估计眼皮的地标,虹膜和瞳孔,眨眼从近红外图像检测基于统计学习可变形形状模型和本地外观。与面部具有里程碑意义的估计问题,相比之下,不同的形状模型是适用于所有眼睛states-closed眼睛,开放与虹膜眼可见,和开放的眼睛虹膜和瞳孔可见处理self-occluding眼睛组件之间的交互。最可能的眼睛状态是决定基于学习当地的外观。评价三种不同的现实数据表明,拟议中的三态变形形状模型达到性能最先进的开放的眼睛虹膜和瞳孔状态,在归一化误差低于0.04。眨眼检测召回性能可高达90%,没有直接使用瞳孔检测。Cross-corpus评价结果表明,该方法提高了先进的眼睑检测算法。这种统一的方法极大地促进眼睛活动分析研究和实践不同类型的眼睛活动时是必需的,而不是为每个类型采用不同的技术。我们的工作研究首次提出一个统一的眼睛眼睛活动估计的方法从近红外图像,取得了最先进的眼睑估计和眨眼检测性能。gydF4y2Ba

介绍gydF4y2Ba

眼睛活动极大的兴趣观察人类的注意力和意图以来(gydF4y2BaDuchowski 2007gydF4y2Ba)。眼睛活动的类型和应用到目前的研究发现,包括视线方向的定位设备瘫痪的人(gydF4y2BaDuchowski 2007gydF4y2Ba);瞳孔大小、眨眼、眼球运动对认知负荷测量(固定和扫视)(gydF4y2Ba陈et al ., 2011gydF4y2Ba),情感识别(gydF4y2Ba陆et al ., 2015gydF4y2Ba)、视觉行为改变(gydF4y2Ba陈et al ., 2013gydF4y2Ba)、人类活动识别(gydF4y2Ba提高身价et al ., 2011gydF4y2Ba)和精神疾病诊断(gydF4y2Ba比达尔et al ., 2012gydF4y2Ba);情感识别眼睑闭包(gydF4y2Ba奥罗斯科et al ., 2009gydF4y2Ba)和疲劳检测(gydF4y2Ba杨et al ., 2012gydF4y2Ba;gydF4y2BaDaniluk et al ., 2014gydF4y2Ba)。而不是这些动态变化的眼睛组件(眼睑打开,瞳孔的大小和位置,眨眼长度和深度)形成眼睛活动,静态的眼睛图片也感兴趣的尤其是在生物识别技术。例如,眼睛形状是脸对脸的一部分验证(gydF4y2BaVezzetti et al ., 2016gydF4y2Ba,gydF4y2Ba2017年gydF4y2Ba),从眼睛图像提取虹膜纹理身份验证(gydF4y2Ba鲍耶和伯奇,2016年gydF4y2Ba)。然而,捕捉这些眼睛活动的基础或生物统计学信息从一个眼影是眼睑轮廓和瞳孔轮廓。与特定的算法,眼睑闭合,瞳孔大小,眨眼,眼动,视线方向也可以测量或开发。因此,健壮和准确评估眼睑和瞳孔轮廓是这些应用程序所必需的。gydF4y2Ba

历史上,眼皮眼睛轮廓估计通常是进行图像在正常光照条件和远场。在这种情况下,只有虹膜边界是可见的,而不是学生;因此,瞳孔轮廓估计不可用时,眼睑轮廓只能估计眨眼但没有其他类型的活动。获得一个可靠的瞳孔轮廓、红外(IR)照明是必需的。用红外摄像机,亮或暗的学生效果可以帮助学生区别于背景(gydF4y2BaDuchowski 2007gydF4y2Ba;gydF4y2Ba2010年汉森和霁gydF4y2Ba精确的瞳孔大小变化),同时可穿戴式红外摄像机是需要给眼睛特写红外图像,然而,这使得所有其他结构,如眼睑和虹膜,眼睛在红外图像差眼睛活动检测。最近的应用程序的精神状态和行为研究需求尽可能多的类型的眼睛活动(gydF4y2Ba陈et al ., 2011gydF4y2Ba)。因此,可穿戴eye-directed红外相机是理想的眼睛捕捉到所有类型的活动在现实生活中,尤其是对测量瞳孔大小。gydF4y2Ba

虽然在近红外眼瞳孔大小的方法估计图像经常被研究过,一些调查(gydF4y2BaFuhl et al ., 2017gydF4y2Ba)已进行到眼睑轮廓估计。除了能够估计闭目,眨眼,健壮的眼睑轮廓估计可以提高学生轮廓估计,因为它减少了背景噪音通过限制搜索眼睑内瞳孔轮廓。gydF4y2Ba

然而,挑战是:(i)与眼睛图像正常光照条件下,红外光谱照度消除颜色信息,并呈现一些健壮的特性,比如眼角落和虹膜边缘薄弱和不显著的,而学生和睫毛功能强大但可以改变显著与眼球运动,而不是一个常数虹膜大小,使独特的眼睛一般特性更加复杂;(2)眼睛近场高分辨率图像引入更多的睫毛比远场细节,对眼睑轮廓估计不需要的噪声。此外,细粒度的眼睑轨迹可以在眨眼检测结果不是那么简单检测只有两种状态的封闭和开放的眼睛。此外,运动模糊由于眼睑运动,很少发生在远场的眼睛图片,会削弱一些独特的眼睛的功能,进一步加剧了这一问题。可以找到一些例子gydF4y2Ba图1gydF4y2Ba。gydF4y2Ba

图1gydF4y2Ba。为什么近红外眼睛活动估计是困难的:与远场non-IR眼科图像高分辨率(第一行的gydF4y2Ba(一)gydF4y2Ba)(gydF4y2BaAlabort-i-Medina et al ., 2014gydF4y2Ba)和低分辨率(第二和第三行gydF4y2Ba(一)gydF4y2Ba)(gydF4y2BaMohanakrishnan et al ., 2013gydF4y2Ba),睫毛在哪里几乎看不见和皮肤之间的强度,虹膜和巩膜通常是独特的,眼睛红外近场图像,gydF4y2Ba(B)gydF4y2Ba增强学生之间的对比及其周边地区,但削弱肌肤之间的反差,虹膜和巩膜。特写镜头突出了大眼睛的外观差异由于种族,闪烁,运动模糊,睫毛密度、光照变化,相机位置比远场的观点。的前两行gydF4y2Ba(B)gydF4y2Ba从任务分析1数据集(gydF4y2BaEpps和陈,2018gydF4y2Ba2)和任务分析的数据集(gydF4y2Ba陈et al ., 2013gydF4y2Ba),分别,这是自然的眼部运动期间记录的任务。第三行是公开的(gydF4y2BaFuhl et al ., 2017gydF4y2Ba)数据集。gydF4y2Ba

面部的具有里程碑意义的检测图像在野外已经取得强劲表现(gydF4y2Ba熊和De la Torre, 2013gydF4y2Ba;gydF4y2Ba冯et al ., 2015gydF4y2Ba),并通过类比这些计算技术可以应用于眼部图像。然而,眼睛有其独特的特征是不同的。最大的区别是,眼睛出现时可以完全变形的眼睛关闭,因为主要组件(学生和iris-disappear,以及眼睛的角落,从根本上改变眼睛的几何结构图像。由于这个基本结构变化的问题是更严重阻塞的面部组件在面部具有里程碑意义的检测,因为建模组件有时不存在当应用基于模型的方法。gydF4y2Ba

在本文中,我们的目标是估计眼睑和瞳孔地标,眨眼事件从近红外图像同时重要的描述眼睛活动在一个完整的光谱。具体地说,我们想要回答两个问题:(i)眼睑和瞳孔地标是否可以使用可变形形状模型可靠,并有效地检测到眼睛近红外图像、可变性由于眨眼,详细的睫毛和眼睑周围的低对比度任务放大特写镜头,没有调查;和(2)如何可靠地单独眨眼从眼睛活动使用可变形形状模型眼地标,不使用任何知识的另一只眼睛的组件,而不是现有的算法眨眼检测或瞳孔大小估计通常使用阈值来指示眼睑是足够接近或瞳孔大小是足够小的眨眼和丢弃瞳孔大小在瞳孔大小估计当它足够小。这些现有的算法需要精确的阈值,但它们几乎广义为每个人一个上下文。提出了基于模型的方法可以克服这种限制。同时是小说被集成到可变形形状模型作为面部里程碑式的发现没有明显的几何结构变化的问题。gydF4y2Ba

相关工作gydF4y2Ba

大多数研究眼睑和眨眼检测是额的脸在正常光线条件下拍摄的图像和远场。他们通常开始于人脸识别,然后估计眼睛区域,根据地形裁剪规则(gydF4y2Ba本森山et al ., 2006gydF4y2Ba;gydF4y2BaBacivarov et al ., 2008gydF4y2Ba;gydF4y2Ba杨et al ., 2012gydF4y2Ba;gydF4y2BaMohanakrishnan et al ., 2013gydF4y2Ba;gydF4y2BaDaniluk et al ., 2014gydF4y2Ba;gydF4y2BaYahyavi et al ., 2016gydF4y2Ba)或利用面部地标(gydF4y2Ba弗里德曼et al ., 2018gydF4y2Ba)。眼睛图像只与清晰的视图低分辨率虹膜眼睑轮廓。一些研究(gydF4y2BaAlabort-i-Medina et al ., 2014gydF4y2Ba)研究了高分辨率或睫毛的眼睛特写图像清晰可见。gydF4y2Ba

眼睑检测gydF4y2Ba

眼睑检测的一般主要是利用强度的差异或边缘之间的皮肤,虹膜和巩膜。方法到目前为止包括寻找最大响应的点上眼睑和下眼睑过滤器(gydF4y2Ba棕褐色、张,2006年gydF4y2Ba;gydF4y2BaDaniluk et al ., 2014gydF4y2Ba);一些检查眼角落点的多项式拟合,对和边缘段上方虹膜中心的三元组地形标准(gydF4y2BaSirohey et al ., 2002gydF4y2Ba);和搜索在抛物线是通过眼睛的角落点最大化目标函数包括边缘,强度和区域(gydF4y2Ba郭和汉娜,2005年gydF4y2Ba)。同样的,gydF4y2BaFuhl et al。(2017)gydF4y2Ba发现上下眼睑的眼睛特写红外图像边缘强度变化的基础上眼睑。下眼睑是首先发现,初始点搜索沿着一条线的位置对应的峰值强度直方图。附近的位置,满足最大区域的标准差异,梯度阈值,和凹多项式被保存了下来。根据地形上眼睑的搜索区域是有限的规则。在这个区域,三个点的多项式拟合的强度变化进行评估值和最大的变化是选择。gydF4y2Ba

这些技术需要可靠的和独特的眼角落或/和眼睛虹膜特性和可能不可靠的红外图像的强度皮肤,虹膜和巩膜是模糊的。此外,这些方法的参数或设计选择经验,没有考虑不同程度的遮挡眼睛组件(虹膜、瞳孔和下眼睑),限制其普遍性眼睑检测在各种各样的眼睛出现在无约束场景。gydF4y2Ba

对于更复杂的基于模型的方法,预定义的模型初始化之前小说眼部图像对齐的最佳位置。gydF4y2Ba本森山et al。(2006)gydF4y2Ba的手工制作的2 d生成基于解剖学的眼睛眼睛形状模型结构,包括上、下眼睑,巩膜,眼角落和虹膜。上下眼睑进一步由三个或四个附带的。11个参数用来控制结构,虹膜眼睑的运动和2 d运动。拟合参数化眼模型对小说形象构成的问题跟踪Lucas-Kanade梯度下降的运动参数。由于个人眼睛表象和照度变化反映被手动初始化减轻每只眼睛的大小和质地。gydF4y2Ba奥罗斯科et al。(2009)gydF4y2Ba还使用了一个参数化形状模型但是来自手工标准设计电脑动画行业的外貌的追踪。这也需要小心手动初始化,从near-frontal学习在线图像的纹理。gydF4y2Ba杨et al。(2012)gydF4y2Ba采用four-landmark可变形模板,安装一个可能性的地图眼睛区域通过最大化总可能性。可能是由Mahalanobis距离映射到肤色分布,由聚类得到的颜色和纹理描述符。gydF4y2Ba

所有这些方法都证明了低分辨率的眼睛图片和使用单一形状模型眼睛眼睛打开和关闭图片,所以,即使眼睛关闭,虹膜仍然是一个有效的和可见的形状模型的一部分(gydF4y2Ba奥罗斯科et al ., 2009gydF4y2Ba),这毫无意义。gydF4y2Ba

棕褐色、张(2006)gydF4y2Ba首先确定眼睛的状态打开或关闭通过检查虹膜的存在使用强度和边缘信息。然后眼睛功能建模为一条直线或可变形模板之前手动初始化和应用程序的标准卢卡斯金跟踪框架。gydF4y2Ba

最近,gydF4y2BaAlabort-i-Medina et al。(2014)gydF4y2Ba三个标准的可变形模型拟合技术相比,主动外观模型(AAM),限制本地模型(CLM)和监督下降法(SDM)跟踪眼睑的变形和运动、虹膜和瞳孔。为了正确代表开放和完全关闭眼睛,两套形状模型被用于两个眼睛状态。与手动初始化的形状或纹理和以前的工作一样,最初的形状模型是统计从训练数据,使更少的假设一个人的眼睛的形状和纹理。学习与评价进行了单独开启和关闭眼睛图像。开放眼图像,结果表明,麦时表现最好的累积误差分布(CED)规范化眼睛大小< 0.05,否则SDM是最好的选择。闭上眼睛图像、长效磺胺表现最好。gydF4y2Ba

这项工作展示了潜在的应用面部里程碑式的检测方法,尤其是SDM技术,开放眼眼睛远场高分辨率图像运动跟踪,然而,他们完全关闭眼睛图像的性能较差。可行性眼睛近红外图像是未知的,没有如何确定开放和封闭的眼睛状态和训练有素的形状模型如何影响个人眼睛对准的状态是未知的。gydF4y2Ba

眨眼检测gydF4y2Ba

有各种各样的眨眼检测技术在文献中,可以分为四个主要组。第一个取决于虹膜和瞳孔的存在(gydF4y2Ba棕褐色、张,2006年gydF4y2Ba;gydF4y2Ba陈和艾普,2014gydF4y2Ba)。例如,对于近红外眼图像,除了声明一个眨眼在没有学生团,gydF4y2Ba陈和艾普(2014)gydF4y2Ba雇佣两个椭圆配件检测学生团。一个安装在整个瞳孔轮廓,另一个是安装在底部一半轮廓,眨眼就由眼睑瞳孔阻塞的程度。然而,这些方法需要先验知识的学生或虹膜blob和不适合情况的底部blob被挡住。gydF4y2Ba

第二个是基于眼睑距离与一个预定义的阈值,例如,眼睛宽度及其孔径之间的比率(gydF4y2BaBacivarov et al ., 2008gydF4y2Ba)。然而,阈值的决策可能是特别困难的细粒度的眼睑的轨迹。gydF4y2Ba

第三是眼睛的运动。gydF4y2BaMohanakrishnan et al。(2013)gydF4y2Ba提出了运动矢量差,面对区域和眼睛区域检测眨眼,因为运动矢量的眼睛区域可以“随机”在闪烁,虽然它通常是类似于面对地区时,眼睑仍然是相对于脸上。而不是确定相似度阈值,gydF4y2BaAppel et al。(2016)gydF4y2Ba提取特征强度差异的两个相邻帧专门为近红外图像。然而,这些方法可能不能够发现长在这些以来眨眼,眼皮也不动。在最近的工作中,gydF4y2BaFogelton和Benesova (2018)gydF4y2Ba利用运动矢量的眼睛区域和学习序列使用递归神经网络模型,眨眼侦测眨眼完整性和实现相似或略比其他方法更好的性能在四个数据集。gydF4y2Ba

最后直接从眼睛出现在图像检测眨眼。gydF4y2BaYahyavi et al。(2016)gydF4y2Ba采用主成分分析和人工神经网络的开放和封闭的眼睛图片。gydF4y2Ba穆罕默迪et al。(2015)gydF4y2Ba开放和封闭的眼睛发现州通过寻找一个合适的阈值强度变化。gydF4y2BaBacivarov et al。(2008)gydF4y2Ba用麦参数的差异在开放和封闭的眼睛图像识别眨了眨眼。gydF4y2Ba太阳et al。(2013 b)gydF4y2Ba使用支持向量机分类每一帧开始,先端和抵消眨眼和构造的时序模型HMM-SVM确定眨眼的事件。他们发现,这个时间模型和强度特性明显优于使用多层次SVM和猪,枸杞多糖,伽柏和光学流特性来检测眨了眨眼。gydF4y2Ba

报道眨眼检测性能在先前的研究通常是高,精度高于90%。一方面,这些结果对于低分辨率non-IR眼睛的图像,和值得怀疑的是,近距离红外图像包含各种详细的眼部外观变化可以简单地分为开放和封闭的眼睛。另一方面,大多数数据集评估期间,收集了休闲场景自愿眨眼经常发生,就是完全封闭的眼睛。然而,在任务,大多数眨眼部分和最完整眨眼有盖子接近彼此,但不一定触摸(gydF4y2BaBrosch et al ., 2017gydF4y2Ba)。这些无意识的眨眼可能有不同的持续时间、幅度和速度比眼睛关闭和打开自愿眨眼(gydF4y2Ba安倍et al ., 2014gydF4y2Ba)。gydF4y2Ba

瞳孔轮廓估计gydF4y2Ba

自学生只是不同的红外照明下,可以准确地测量其大小只有当学生的解析是足够好,眼睛瞳孔检测总是进行红外图像。估计瞳孔轮廓可以安装一个椭圆模型获取瞳孔中心,瞳孔大小和感兴趣的其他特性。一个简单的方法就是通过二值化段背景的学生,然而,它是具有挑战性的寻找各种眼睛的一种自适应阈值图像大变化。gydF4y2Ba陈和艾普(2014)gydF4y2Ba提出了一种自调整阈值方法需要最小参数调优为near-filed红外图像处理这些变化。其他算法运行在远程红外图像的目标检测瞳孔中心。这些算法(gydF4y2BaFuhl et al ., 2016gydF4y2Ba)涉及multi-thresholding、边缘滤波、形态学操作,强度梯度和迭代搜索适当的点满足一系列的标准。gydF4y2BaFuhl et al。(2016)gydF4y2Ba相比6这样start-of-the-art算法与头戴红外眼瞳孔中心检测图像。他们发现他们的对偶算法优于别人。在该算法中,第一种方法使用边缘图像,形态学操作,和启发式的选择最好的边缘是审判,如果这失败,使用先进的blob检测。gydF4y2Ba

然而,确定最佳参数设置是一个未知的数据并不容易,和敏感性不同的参数设置,可以通过cross-corpus检查评估,是未知的。此外,复杂的基于模型的方法尚未在瞳孔检测。gydF4y2Ba

提出了三态变形模型gydF4y2Ba

瞳孔、虹膜和眼皮总是相互作用在正常眼睛的行为,一些眼睛活动不能只检测到。例如,如果眨眼检测基于瞳孔大小、健壮的瞳孔检测是必需的。然而,瞳孔大小估计通常很不可靠,因为眨眼或部分眼皮遮挡(例如,睫毛下)和眨眼改变瞳孔的大小并不是唯一的因素,因此,可靠的瞳孔大小估计需要眨眼间出现的先验知识。在这项研究中,我们提出一个统一的方法利用可变形形状模型来检测眼睑轮廓,瞳孔轮廓,同时眨眼。gydF4y2Ba

然而,不同的部分遮挡面部具有里程碑意义的检测的问题,面临的大多数组件仍在位置和可辨认的,大多数的眼睛组件可以完全消失时,眼睛是关闭或关闭或患有运动模糊,如图所示gydF4y2Ba图1 bgydF4y2Ba。对于形状模型,每个组件的形状需要预定义的;但无法保证这些预定义的形状出现在每只眼睛的形象,这可能影响参数优化过程。这是通过区分不同眼睛状态来解决。拟议的框架所示gydF4y2Ba图2gydF4y2Ba下,每只眼睛状态(gydF4y2BaegydF4y2Ba)和给定的初始具有里程碑意义的位置(gydF4y2Ba年代gydF4y2Ba),每个里程碑的增量(gydF4y2BaΦgydF4y2Ba)是训练有素的带注释的地标。与此同时,当地的模型外观由补丁在每个注释的里程碑式的特点(gydF4y2BaFgydF4y2Ba)也是训练。在测试阶段,最初的地标在考试眼影将逐步根据训练形状模型在每只眼睛的状态下,和当地出现在最后的地标(gydF4y2Ba年代gydF4y2Ba′gydF4y2Ba)被收集。只有相似的眼睛状态(gydF4y2BadgydF4y2Ba)之间的本地外观和训练有素的外观模型最大的选择和使用选定的眼睛状态的地标。gydF4y2Ba

图2gydF4y2Ba。拟议的眼睑外形统一方法的概述,瞳孔轮廓,眨眼估计,gydF4y2Ba年代gydF4y2Ba是具有里程碑意义的位置,gydF4y2BaegydF4y2Ba是眼睛,gydF4y2BaΦgydF4y2Ba是训练有素的形状模型,gydF4y2BaFgydF4y2Ba是训练有素的本地外观模型,gydF4y2BadgydF4y2Ba之间的相似性是当地出现在最后的地标和训练有素的外观模型。gydF4y2Ba

三态眼睛变形模型gydF4y2Ba

我们提出三种不同的眼睛状态眼睑里程碑式的检测识别眨眼之前。他们闭着眼睛gydF4y2BaegydF4y2Ba1gydF4y2Ba),打开眼睛虹膜(gydF4y2BaegydF4y2Ba2gydF4y2Ba),打开眼睛虹膜和瞳孔(gydF4y2BaegydF4y2Ba3gydF4y2Ba)。每只眼睛状态一个预定义的适用于不同数量的地标(gydF4y2Ba,在那里gydF4y2BalgydF4y2Ba我gydF4y2Ba是地标的数量,gydF4y2Ba我gydF4y2Ba= 1,2,3),如所示gydF4y2Ba图3gydF4y2Ba。这些地标不包含沟和眼睛的凸起结构gydF4y2Ba本森山et al。(2006)gydF4y2Ba和gydF4y2BaAlabort-i-Medina et al。(2014)gydF4y2Ba因为他们不区分红外眼图像。闭眼和睁眼与虹膜与眨眼因为视力不能出现没有学生。包括开放的眼睛虹膜状态的原因是常见的在任务期间观察到眼睑移动快速闪烁但并不总是完全关闭。在这种状态下,学生完全闭塞,但虹膜的下半部分仍然是可见的。这只眼睛状态在任务(并不罕见gydF4y2BaBrosch et al ., 2017gydF4y2Ba),我们常常观察这种partially-open-eye闪现在我们的数据集所示gydF4y2Ba图1 bgydF4y2Ba。gydF4y2Ba

图3。(一)gydF4y2BaL = 28地标(用蓝点)的状态打开眼睛瞳孔和虹膜(gydF4y2BaegydF4y2Ba= 3),gydF4y2Ba(B)gydF4y2BaL = 20地标开放与虹膜(眼睛gydF4y2BaegydF4y2Ba= 2),gydF4y2Ba(C)gydF4y2Ba闭上眼睛(L = 12地标gydF4y2BaegydF4y2Ba= 1)。每个里程碑式定心一小块(用一个红场)为当地的外观。这些地标包括每只眼睛的眼睛形状模型的状态。所有三个眼都来自同一主题的图片,还可以观察到他们有着巨大的差异。gydF4y2Ba

学习形状和外观gydF4y2Ba

培训数据与眼睛地标为每只眼睛状态(gydF4y2BaegydF4y2Ba我gydF4y2Ba,gydF4y2Ba我gydF4y2Ba= 1,2,3),我们首先经图像gydF4y2Ba我gydF4y2Ba′,我gydF4y2Ba=gydF4y2BaWgydF4y2Ba(gydF4y2Ba我gydF4y2Ba′gydF4y2Ba),它的地标,gydF4y2Ba年代gydF4y2Ba=gydF4y2BaWgydF4y2Ba(gydF4y2Ba年代gydF4y2Ba′gydF4y2Ba),所有训练图像的平均大小,其中包括规模和翻译。gydF4y2BaWgydF4y2Ba(•)是经操作员。然后我们不仅火车的形状模型gydF4y2BaΦgydF4y2Ba我gydF4y2Ba而且每只眼睛的外观模型状态,gydF4y2BaFgydF4y2Ba我gydF4y2Ba,gydF4y2Ba我gydF4y2Ba= 1,2,3。gydF4y2Ba

最近提议SDM (gydF4y2Ba熊和De la Torre, 2013gydF4y2Ba)被选为培训这些形状模式。长效磺胺是一个监督歧视模型求解一般非线性优化问题,在面部里程碑式的发现引起了极大关注。这种技术定义了一个本地外观模型在预定义的地标图像,并构建一个非线性映射函数gydF4y2BaΦgydF4y2Ba当地的外观特征之间{gydF4y2BafgydF4y2Ba(gydF4y2Ba我,年代gydF4y2Ba)}和形状更新通过一个级联的回归量训练的过程。gydF4y2Ba

判别模型,gydF4y2BaΦgydF4y2Ba:gydF4y2BafgydF4y2Ba(gydF4y2Ba我,年代gydF4y2Ba0gydF4y2Ba)→δgydF4y2Ba年代gydF4y2Ba,是训练通过最小化成本函数与地面真理注释(gydF4y2BaAlabort-i-Medina et al ., 2014gydF4y2Ba;gydF4y2Ba冯et al ., 2015gydF4y2Ba),gydF4y2Ba

在哪里gydF4y2Ba年代gydF4y2Ba*gydF4y2Ba(gydF4y2BangydF4y2Ba)是地面真理的形状gydF4y2BangydF4y2Bath训练图像,δgydF4y2Ba年代gydF4y2Ba(gydF4y2BangydF4y2Ba)=gydF4y2BaΦgydF4y2Ba(gydF4y2BafgydF4y2Ba(gydF4y2Ba我,年代gydF4y2Ba0gydF4y2Ba)是相应的形状更新和gydF4y2Ba年代gydF4y2Ba0gydF4y2Ba(gydF4y2BangydF4y2Ba)是初始状态估计。gydF4y2Ba

非线性映射函数是通过级联序列gydF4y2Ba米gydF4y2Ba线性解释变量gydF4y2BaRgydF4y2Ba:gydF4y2Ba

在哪里gydF4y2BaRgydF4y2Ba米gydF4y2Ba= {gydF4y2Ba一个gydF4y2Ba米gydF4y2Ba,gydF4y2BabgydF4y2Ba米gydF4y2Ba}。回归矩阵gydF4y2Ba一个gydF4y2Ba米gydF4y2Ba和偏见的术语gydF4y2BabgydF4y2Ba米gydF4y2Ba每一个解释变量gydF4y2BaRgydF4y2Ba米gydF4y2Ba可以在封闭的形式通过求解一个线性最小二乘问题的训练数据。gydF4y2Ba

与此同时,当地的每个注释的里程碑式的外观特征被提取。训练有素的外观模型gydF4y2Ba我gydF4y2Bath眼睛状态是当地的平均外观特点:gydF4y2Ba

形状模型gydF4y2BaΦgydF4y2Ba我gydF4y2Ba是用来预测地标,而外观模型gydF4y2BaFgydF4y2Ba我gydF4y2Ba用于区分眼睛状态。gydF4y2Ba

推理的形状和眨眼gydF4y2Ba

地标预计通过更新形状根据映射函数使用当地的外观特性。给定一个小说眼影gydF4y2Ba我gydF4y2Ba′gydF4y2Ba,每只眼睛的眼地标递归更新状态从扭曲的形象gydF4y2Ba我gydF4y2Ba对训练数据,使用相同的变形参数:gydF4y2Ba

通常,后gydF4y2Ba米gydF4y2Ba= 5级联水平,方程(1)收敛(gydF4y2Ba熊和De la Torre, 2013gydF4y2Ba;gydF4y2Ba冯et al ., 2015gydF4y2Ba)。因此,我们可以获得估计眼睛地标gydF4y2Ba年代gydF4y2Ba我gydF4y2Ba和当地的外观特性{gydF4y2BafgydF4y2Ba我gydF4y2Ba(gydF4y2Ba我,年代gydF4y2Ba我,gydF4y2Ba米gydF4y2Ba)}最后更新。眼睛状态gydF4y2BaegydF4y2Ba是由寻找最大余弦相似度(gydF4y2BadgydF4y2Ba我gydF4y2Ba)培训本地外观模型:我gydF4y2Ba

最后一组眼地标的地标是检测眼睛的状态。然后回到原来的图像扭曲形状使用相应的规模和翻译:gydF4y2Ba

与此同时,眨眼是由gydF4y2Ba

因此,检测到眼睛的眼睑轮廓可以找到地标gydF4y2BaegydF4y2Ba= 3或2,上眼睑外形可以当找到gydF4y2BaegydF4y2Ba= 1。瞳孔轮廓只能当发现non-blink形变模型的图像gydF4y2BaegydF4y2Ba= 3。gydF4y2Ba

实验gydF4y2Ba

我们使用三个数据集评估和cross-corpus评估眼地标和眨眼检测的性能。此外,眼睑的唯一算法的估计性能与近红外眼眼睑检测的图像,我们所知。gydF4y2Ba

数据集gydF4y2Ba

1)任务分析(TA1)数据集(gydF4y2BaEpps和陈,2018gydF4y2Ba):红外近场的眼睛被一个头戴现成的摄像头录制视频(30 fps)从24个主题不同的民族在他们完成任务心理和生理(伦理批准获得)。对于每一个主题,有超过1 h的录像。我们选择200图像每个主题的最初几分钟内注释,总共有4800张图片。这些选中的图像包含明显的眼球运动改变前面的视频帧。这个数据集遭受强烈的光照条件,导致弱对比,和一个看不见的虹膜图像,其中一些的第一行所示gydF4y2Ba图1 bgydF4y2Ba。对于模型的训练和测试,我们手动放置12日20日和28地标为每只眼睛状态,完全闭上眼(6%),打开眼睛虹膜(3%),和开放的眼睛虹膜和瞳孔(91%),分别如图所示gydF4y2Ba图3gydF4y2Ba。一半的眼睛图片从所有受试者用于培训和另一半被用于测试。cross-corpus-validation期间,所有眼睛图像被用于测试。gydF4y2Ba

2 (TA2)数据集(b)任务分析gydF4y2Ba陈et al ., 2013gydF4y2Ba):类似于TA1数据集,红外近场眼球运动记录还在任务使用不同的摄像头,但不同的22个主题,在一个室内光线条件(伦理批准获得),其中一些图像的第二行所示gydF4y2Ba图1 bgydF4y2Ba。我们选择4400眼图像从每个主体(200),注释的计划一样TA1数据集进行训练和测试。它们包含8.6%的闭上眼睛,打开眼睛虹膜4.1%,87.3%在虹膜和瞳孔开眼睛。训练和测试图像的比例是一样的,在TA1数据集。gydF4y2Ba

c)gydF4y2BaFuhl et al。gydF4y2Ba数据集(gydF4y2Ba2017年gydF4y2Ba):这个公共数据集包含5101红外近场眼图像从11个科目。他们记录在现实场景和可能包含深思熟虑的眼球运动。一些例子的第三行所示gydF4y2Ba图1 bgydF4y2Ba。这个数据集有一个注释10眼睑地标(gydF4y2BaFuhl et al ., 2017gydF4y2Ba)不管眼睛的状态。因此,我们只能获得眼睑对齐。一半的数据用于训练和另外一半被用于测试方法。的性能预测眼睑地标与最近提议gydF4y2BaFuhl et al。gydF4y2Ba算法(gydF4y2Ba2017年gydF4y2Ba),它只在这个数据集评估眼睑检测没有学生具有里程碑意义的检测和基于模型的方法。gydF4y2Ba

Cross-corpus验证也以两种方式进行。一个是使用gydF4y2BaFuhl et al。gydF4y2Ba算法(gydF4y2Ba2017年gydF4y2Ba)测试所有眼部图像从TA1 TA2没有改变任何参数。另一个是使用模型训练对TA1或TA2测试所有眼部图像从这个数据集。应该注意的是,只有10眼睑地标在美国开放的眼睛虹膜和开放的眼睛虹膜和瞳孔可以被测试,因为我们训练模型在闭眼状态是眼睑的睫毛轮廓相反。gydF4y2Ba

实验设置gydF4y2Ba

在所有的实验中,我们设置本地块的半径约16像素具有里程碑意义,这是对所有数据集评估固定。面向的柱状图的梯度(猪)特性是用来代表当地的外观特性,gydF4y2BafgydF4y2Ba(gydF4y2Ba我,年代gydF4y2Ba),因为据报道有效(gydF4y2Ba冯et al ., 2015gydF4y2Ba)。六个解释变量是用于级联列火车形状模型,因为它发现性能时没有明显变化gydF4y2Ba米gydF4y2Ba> 5,类似gydF4y2BaAlabort-i-Medina et al。(2014)gydF4y2Ba和gydF4y2Ba冯et al。(2015)gydF4y2Ba。每个测试的初始形状图像缩放的比例指的是形状模型训练数据和测试图像大小。gydF4y2Ba

结果与讨论gydF4y2Ba

具有里程碑意义的检测结果给出真正的眼睛gydF4y2Ba

图4 a - cgydF4y2Ba显示曲线为三个眼睛国家促成TA1 TA2数据集,给出真实的眼睛。错误被两眼之间的距离归一化图像在每个角落,和平均所有地标和图片。结果表明,预测虹膜地标(红色曲线)通常是不准确的眼睑地标(蓝色曲线)红外近场图像,可能是因为疲弱的虹膜和巩膜之间的对比。与此同时,开放的眼睛虹膜和瞳孔状态(gydF4y2Ba图4 cgydF4y2Ba)达到最佳性能的三个眼睛。这种状态也是研究最多的眼睛的眼睑检测状态non-IR远场图像。后眼睛拟议中的三态变形模型,具有里程碑意义的估计可以达到相似的归一化误差最先进的面部地标对齐(gydF4y2BaAlabort-i-Medina et al ., 2014gydF4y2Ba;gydF4y2Ba冯et al ., 2015gydF4y2Ba)。然而,闭眼睛的性能(gydF4y2Ba图4一gydF4y2Ba)和开放的眼睛虹膜(gydF4y2Ba图4 bgydF4y2Ba)通常比完全开放的眼睛状态和所有的眼睛组件(gydF4y2Ba图4 cgydF4y2Ba)。很有可能更多的变化,如运动模糊和睫毛的变化主要发生在眼睑运动。同时,减少训练数据的前两种状态。有趣的是,TA2数据集具有更好的图像质量,可以改善眼睛具有里程碑意义的估计只有为国家开放的眼睛虹膜和瞳孔而其他两个州的性能恶化。初步的原因可能是闭眼睛的清晰视图产生不必要的眼睛睫毛相比,模糊图像的细节。gydF4y2Ba

图4。(一个gydF4y2Ba- - - - - -gydF4y2BaC)gydF4y2BaCED曲线对TA1眼三个州和TA2数据集使用SDM眼睛变形模型。gydF4y2Ba(D)gydF4y2Ba只使用CED曲线为眼睑地标gydF4y2BaFuhl et al。gydF4y2Ba算法(gydF4y2Ba2017年gydF4y2Ba)和长效磺胺可变形模型gydF4y2BaFuhl et al。gydF4y2Ba数据集(gydF4y2Ba2017年gydF4y2Ba),gydF4y2Ba(E)gydF4y2Bacross-corpus评价TA1和TA2数据集(解释引用的颜色在这个图的传说中,读者被称为web版本的这篇文章)。值得注意的是,Fuhl等人算法没有眼睑检测TA1 2295的4800个测试图像的数据集在TA2和196的4400个测试图像数据集。这些错误没有计入gydF4y2Ba(E)gydF4y2Ba。gydF4y2Ba

图4 d, EgydF4y2Ba是只有10眼睑地标的CED曲线估计使用Fuhl等人算法和/或公共数据集。作为他们的算法输出多项式曲线的眼睑位置,与注释地面实况,10眼睑地标在预测曲线选择首先定位两眼角落相应注释的,然后搜索最近的点的剩余的带注释的地标。gydF4y2Ba

从gydF4y2Ba图4 dgydF4y2Ba眼睛,我们可以看到SDM-based变形模型达到可比性能Fuhl等人的公共数据集算法。然而,Fuhl等人算法失败6 2434个测试图像(输出零),和这些错误没有考虑到标准化的错误因为地面真理和预测之间的距离零地标来计算是不可能的。gydF4y2Ba

图4 egydF4y2Ba显示了cross-corpus验证eyelid-only地标估计的性能。尽管所有性能下降与评估在相同的数据集相比,三态变形眼睛模型相对比Fuhl等人更可靠的算法,输出零2295的4800个测试图像TA1数据集和196年TA2 4400个测试图像的数据集。规范化眼睑错误gydF4y2Ba图4 egydF4y2Ba不包括这些零输出。然而,我们的方法从来没有零输出虽然地标可以是非常远离地面的真相。gydF4y2Ba

所有这些结果表明,红外眼图像,眼睛可变形模型可以执行对学生具有里程碑意义的检测。这并不奇怪,因为红外线增强了学生之间的区别及其周边地区。同时,当眼睛是完全开放的,睫毛,变化主要是由于瞳孔大小变化,学生/虹膜位置改变,眼睑形状改变个体间(gydF4y2Ba图1 bgydF4y2Ba,gydF4y2Ba6gydF4y2Ba)。闭眼睛的状态和开放的眼睛虹膜状态,大的变化从瞳孔虹膜/形状(只有在开放的眼睛虹膜状态),眼睑运动,眼睑形状和睫毛的形状。即使在一个个体,可以实质性变化由于眼睑运动(gydF4y2Ba图1 bgydF4y2Ba,gydF4y2Ba6gydF4y2Ba)。眼睑里程碑式的发现在这些国家变得困难,和SDM-based变形眼睛退化模型性能和cross-dataset性能证实了这一挑战。总的来说,SDM-based变形模型性能比gydF4y2BaFuhl et al。(2017)gydF4y2Ba基线算法因为眼睑里程碑式的检测性能即使在最糟糕的情况下(gydF4y2Ba图4一gydF4y2Ba闭上眼睛,gydF4y2Ba图4 bgydF4y2Ba打开眼睛虹膜)使用Fuhl等人与算法最好的情况下(完全开放的眼睛)和一个坏的情况下(打开眼睛虹膜)。提出三态SDM-based变形眼睛模型的另一个优势是,我们尊敬的眼睛三个州,和每个适合最合适的眼睛模型这三个模型。由于不恰当的模型是可能的错误减少和三态模型不会遇到眼睑检测失败与Fuhl等人算法发现的前提下眼睑必须满足下处理。gydF4y2Ba

眨眼检测的结果gydF4y2Ba

表1gydF4y2Ba显示了混合矩阵的三个眼睛状态检测TA1和TA2数据集。这些结果表明,使用该方法区分三个眼睛国家可以实现强劲表现,69%以上在回忆。在结果中,打开眼睛虹膜和瞳孔状态获得较高的召回性能比其他两个州。这是最有可能由于精度高的眼睛具有里程碑意义的估计状态。gydF4y2Ba

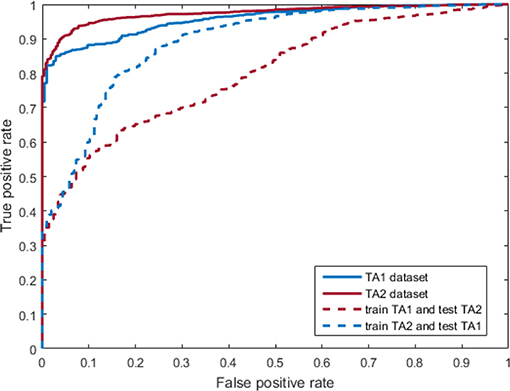

图5gydF4y2Ba接受者操作特征(ROC)曲线显示了眨眼检测,由分组获得美国用蓝色突出显示gydF4y2Ba表1gydF4y2Ba到一个眨眼类。具体地说,召回眨眼检测TA1数据集是89%和91% TA2数据集(坚实的曲线)。注意眨眼检测基于学生的使用提出了三态变形模型方法可见性是小说,而不是直接考察学生或虹膜存在现有的方法(gydF4y2BaBacivarov et al ., 2008gydF4y2Ba;gydF4y2Ba陈和艾普,2014gydF4y2Ba)。结果相媲美的一般性能眨眼non-IR方法远场图像,通常超过90%召回。虚线ROC曲线cross-evaluation眨眼检测性能,在训练和测试数据来自不同的数据集。眨眼检测召回性能会大幅度下降,而精度略有下降。这意味着大量的睁开眼睛虹膜和瞳孔状态被误诊为其他两个眼睛。眼睛不准确预测具有里程碑意义的可能是主要的原因,因为当地的外观从错误中提取地标不能类似于训练有素的外观模型。与此同时,当地的外观从不同的数据集也可能由于环境变化。gydF4y2Ba

所有这些眨眼检测结果表明,使用该三态SDM-based眼睛变形模型来检测眨眼是可行的红外眼图像以及具有里程碑意义的检测。最好使用三个不同的眼睛状态和安装眼模型找到眨眼,这不同于当前眨眼检测技术中提到的部分。然而,拟议的眨眼检测方法依赖于准确的具有里程碑意义的检测。正确性在安装眼模型会导致高眨眼检测性能的更高的眼睛具有里程碑意义的检测性能在开放的眼睛瞳孔和虹膜状态和cross-dataset眨眼检测性能(gydF4y2Ba图5gydF4y2Ba)。虽然没有参数需要在这种方法中,眼神里程碑式的依赖检测扮演类似的角色,这些参数需要设置在眨眼检测现有的技术,但在我们的方法不需要手动调整。gydF4y2Ba

具有里程碑意义的评估结果给出检测眼睛的状态gydF4y2Ba

如前所述,眼睛组件经常相互作用在眼睑的运动,所以很难确定哪些组件应该首先发现。调查该方法基于真正的和发现的眼睛状态也显示这一挑战。gydF4y2Ba表1gydF4y2Ba表明更好的眼睑里程碑式的估计,召回眼睛状态的性能越高,gydF4y2Ba表2gydF4y2Ba展示了眼睑地标估计性能下降由于眼睛状态估计误差。这是因为,gydF4y2Ba图2gydF4y2Ba表明,给定一个新颖的形象,最后预测眼地标从检测到眼睛的状态。从gydF4y2Ba表2gydF4y2Ba,我们可以看到,平均来说,具有里程碑意义的错误增加了约16.7%的TA1数据集和18.6%左右TA2数据集相比,性能考虑到真正的眼睛。当给定一个训练有素的眼睛变形模型从另一个数据集,最后眼睑里程碑式的估计性能明显退化。具有里程碑意义的错误增加了约160和180%的性能考虑到真正的眼睛状态和模型训练从相同的数据集。gydF4y2Ba

这些研究结果给我们提供哪些因素会显著影响性能的概述。在我们的研究中,cross-dataset测试性能是不可接受的,这表明很大变化是因为不同的实验设置,设备,和参与者,没有抓住SDM-based眼睛变形模型。因此,更多的技术需要研究进一步改善眼睛具有里程碑意义的估计为了获得更精确的眼睛眼睛活动可穿戴计算。gydF4y2Ba

一些典型的具有里程碑意义的检测结果gydF4y2Ba

图6gydF4y2Ba提出了一些好的和坏的例子使用的三个数据集。一般来说,如果表现良好的形状模型,对齐可以有非常小的错误,比Fuhl等人算法所示gydF4y2Ba图4 dgydF4y2Ba,而错误可以大如果形状模型没有变形的方向应该从长效磺胺。这些失败大多是罕见的情况下在任务,因此,为他们训练的例子尚不多见。gydF4y2Ba

图6gydF4y2Ba。成功(第1行)和失败(第二行)眼睛具有里程碑意义的检测选择从TA1 TA2和Fuhl等人数据集。红点是带注释的地标和蓝色的是预测地标(解释引用的颜色在这个图的传说中,读者被称为web版本的这篇文章)。gydF4y2Ba

未来的工作将集中在改善性能的方法对这些罕见的眼球运动和cross-dataset性能。一个方向是收集和注释数据闭上眼睛和开放的眼睛瞳孔状态从不同的人。更多的最初的眼睛具有里程碑意义的位置需要被添加到火车的模型和算法选择有用的初始位置模型训练可以开发。这些都是让模型学的更好,让更多的变化。另一个方向是使用卷积神经网络,近年来已经开发好,发现在面部表现优于其他方法具有里程碑意义的定位和执行多任务学习(gydF4y2Ba太阳et al ., 2013 agydF4y2Ba;gydF4y2Ba杰克逊et al ., 2016gydF4y2Ba;gydF4y2BaRanjan et al ., 2017gydF4y2Ba)。大量的参数训练神经网络将掌握大多数变化呈现三个眼,然而,该方法可能非常昂贵由于需要大量的注释和计算资源。gydF4y2Ba

结论gydF4y2Ba

眼睛活动,包括眼睑运动,瞳孔大小固定,扫视,眨眼,吸引越来越多的关注人类精神状态分析可穿戴的相机。然而,大多数研究都集中在non-IR眼睛远场图像来计算个人眼睛活动如眨眼或眼科中心。这项工作提出了一个统一的方法来获得眼睑轮廓,瞳孔轮廓,和眨眼事件,大多数眼睛活动可以进一步提取。在这种方法中,眼睑轮廓和瞳孔轮廓得到更新的可变形形状模型的统计学习最可能的眼睛状态。同时,眨眼检测基于最可能的眼睛状态是否包含学生。结果在三个不同的数据集包含大变化的眼睛出现在现实的情况下展示与面部具有里程碑意义的检测性能,与同类眨眼估计性能,在non-IR远场图像,因此,变形形状模型适用于眼睑和学生具有里程碑意义的检测从近红外眼图像。该方法也导致更好的比眼睑检测算法和可靠的结果,gydF4y2BaFuhl et al。(2017)gydF4y2Ba基于强度变化对近红外图像,不模型眼的形状或提取学生信息,未能发现眼睑的眼睛近红外图像。然而,由于不同的眼睛活动的特定属性仅在近红外眼把睫毛和眼睑拓扑变化由于观点,而且完整的几何和纹理变化由于睫毛的交互,眼睑和瞳孔,睫毛和眼睑里程碑式的估计完全关闭的情况下眼睛,稍微打开眼睛,眼睛具有里程碑意义的评估以及在cross-corpus眨眼检测评估,仍具有挑战性。更多的方法需要研究进一步改善眼地标和眨眼检测近红外图像。眼睛这是第一个研究集中在近红外图像获取眼睑和瞳孔地标和眨眼基于可变形形状模型,并使用不同的眼睛状态处理眼睛的重要几何结构变化图像。未来的工作将包括使用可穿戴系统获得所有眼睛活动开展和提高人类精神状态分析。gydF4y2Ba

数据可用性声明gydF4y2Ba

这个手稿不公开的数据集,因为没有同意从参与者对公共可用性。请求访问数据集应该指向gydF4y2Baj.epps@unsw.edu.augydF4y2Ba。gydF4y2Ba

道德声明gydF4y2Ba

会议2014年9月9日的新南威尔士大学人类研究伦理顾问小组很满意,这个项目是最低限度的道德影响和满足需求的国家声明在人类道德行为的研究。考虑该小组的建议,副校长(研究)已经批准了这个项目。这个批准之日起有效期为5年。gydF4y2Ba

作者的贡献gydF4y2Ba

SC和我的想法。SC的文献调查实验,进行论文写作。我提供深刻的讨论和反馈在写作。gydF4y2Ba

资金gydF4y2Ba

这项工作由美国陆军ITC-PAC支持部分,通过合同fa5209 - 17 - p - 0154。作者的观点,并不反映的美国军队。gydF4y2Ba

的利益冲突gydF4y2Ba

作者声明,这项研究是在没有进行任何商业或财务关系可能被视为一个潜在的利益冲突。gydF4y2Ba

引用gydF4y2Ba

安倍,K。,Sato, H., Ohi, S., and Ohyama, M. (2014). “Feature parameters of eye blinks when the sampling rate is changed,” in《IEEE地区10会议(TENCON)gydF4y2Ba(曼谷)。gydF4y2Ba

Alabort-i-Medina, J。曲,B。,和Zafeiriou, S. (2014). “Statistically learned deformable eye models,” in冬季会议上的应用计算机视觉(大会)研讨会gydF4y2Ba(苏黎世),285 - 295。gydF4y2Ba

Appel, T。,Santini, T., and Kasneci, E. (2016). “Brightness-and motion-based blink detection for head-mounted eye trackers,” in诉讼的ACM国际联合会议上普遍的和无处不在的计算:兼职gydF4y2Ba(海德堡),1726 - 1735。gydF4y2Ba

Bacivarov,我。Ionita, M。,和Corcoran, P. (2008). Statistical models of appearance for eye tracking and eye-blink detection and measurement.IEEE反式。Consum。电工实习。gydF4y2Ba54岁,1312 - 1320。doi: 10.1109 / TCE.2008.4637622gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Brosch, j·K。吴,Z。,Begley, C. G., Driscoll, T. A., and Braun, R. J. (2017). Blink characterization using curve fitting and clustering algorithms.j .模型。Ophthal。gydF4y2Ba1,60 - 81。gydF4y2Ba

提高身价,。,W一个rd,J. A., Gellersen, H., and Tröster, G. (2011). Eye movement analysis for activity recognition using electrooculography.IEEE反式。模式肛门。机器英特尔。gydF4y2Ba33岁,741 - 753。doi: 10.1109 / TPAMI.2010.86gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

陈,S。,和艾普,J。(2014)。高效和健壮的瞳孔大小和眨眼估计从近场人机交互的视频序列。gydF4y2BaIEEE反式。Cybernet。gydF4y2Ba44岁,2356 - 2367。doi: 10.1109 / TCYB.2014.2306916gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

陈,S。,艾普,J。,和Chen, F. (2013). “Automatic and continuous user task analysis via eye activity,” in智能用户界面程序(IUI)gydF4y2Ba(圣塔莫尼卡,CA), 57 - 66。gydF4y2Ba

陈,S。,艾普,J。,Ruiz, N., and Chen, F. (2011). “Eye activity as a measure of human mental effort in HCI,” in智能用户界面程序(IUI)gydF4y2Ba(Palo Alto, CA)。gydF4y2Ba

Daniluk, M。,Rezaei, M., Nicolescu, R., and Klette, R. (2014). “Eye status based on eyelid detection: a driver assistance system,” in国际会议上计算机视觉和图形gydF4y2Ba(Cham:施普林格,171 - 178。gydF4y2Ba

艾普,J。,和陈,S。(2018)。对可穿戴behaviometrics自动任务分析:。gydF4y2BaIEEE系统。男人Cybernet。杂志gydF4y2Ba4、15 - 20。doi: 10.1109 / MSMC.2018.2822846gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

冯,z . H。,胡锦涛,G。,Kittler, J., Christmas, W., and Wu., X-J. (2015). Cascaded collaborative regression for robust facial landmark detection trained using a mixture of synthetic and real images with dynamic weighting.IEEE反式。图像的过程。gydF4y2Ba24岁,3425 - 3440。doi: 10.1109 / TIP.2015.2446944gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Fogelton,。,和Benesova, W. (2018). Eye blink completeness detection.第一版。视觉形象的理解gydF4y2Ba。176 - 177,78 - 85。doi: 10.1016 / j.cviu.2018.09.006gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

弗里德曼,L。,Re我米er,B., Mehler, B., and Freeman, W. T. (2018). “Cognitive load estimation in the wild,” in计算系统的人机工程的会议上因素gydF4y2Ba(蒙特利尔QC)。doi: 10.1145/3173574.3174226gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Fuhl, W。,Santini, T., and Kasneci, E. (2017). “Fast and robust eyelid outline and aperture detection in real-world scenarios,” in冬季会议上的应用计算机视觉(WACV)gydF4y2Ba(圣罗莎,CA)。doi: 10.1109 / WACV.2017.126gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Fuhl, W。,Ton年代en,米。,提高身价。,和Kasneci, E. (2016). Pupil detection for head-mounted eye tracking in the wild: an evaluation of the state of the art.机器视觉:。gydF4y2Ba27日,1275 - 1288。doi: 10.1007 / s00138 - 016 - 0776 - 4gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

汉森,d . W。,和Ji, Q. (2010). In the eye of the beholder: a survey of models for eyes and gaze.IEEE反式。模式肛门。机英特尔gydF4y2Ba。32岁,478 - 500。doi: 10.1109 / TPAMI.2009.30gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

杰克逊,a。Valstar, M。,和Tzimiropoulos, G. (2016). “A CNN cascade for landmark guided semantic part segmentation,” in欧洲计算机视觉会议(大会)gydF4y2Ba(阿姆斯特丹),143 - 155。gydF4y2Ba

郭,P。,和Hannah, J. (2005). “An improved eye feature extraction algorithm based on deformable templates,” inIEEE国际会议上图像处理(ICIP)gydF4y2Ba(热那亚)。doi: 10.1109 / ICIP.2005.1530278gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

陆,Y。,Zheng, W., Li, B., and Lu, B. (2015). “Combining eye movements and EEG to enhance emotion recognition,” in进行人工智能国际联合大会(IJCAI)展出gydF4y2Ba(布宜诺斯艾利斯)。gydF4y2Ba

穆罕默迪,G。,Shanbehzadeh, J., and Sarrafzadeh, H. (2015). A fast and adaptive video-based method for eye blink rate estimation.Int。j .放置第一版。Res。gydF4y2Ba5,105 - 114。gydF4y2Ba

Mohanakrishnan, J。中岛美嘉年代。Odagiri, J。,和Yu, S. (2013). “A novel blink detection system for user monitoring,” inIEEE / ACM效用和云计算国际会议(UCCV)车间gydF4y2Ba(坦帕,FL)。doi: 10.1109 / UCCV.2013.6530806gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

本森山,T。金,T。肖,J。,和Cohn, J. F. (2006). Meticulously detailed eye region model and its application to analysis of facial images.IEEE反式。模式肛门。机器英特尔。gydF4y2Ba28日,738 - 752。doi: 10.1109 / TPAMI.2006.98gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

奥罗斯科,J。罗卡角,X。,和Gonzlez, J. (2009). Real-time gaze tracking with appearance-based models.机器视觉:。gydF4y2Ba20岁,353 - 364。doi: 10.1007 / s00138 - 008 - 0130 - 6gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

野生动物,R。,Patel, V. M., and Chellappa, R. (2017). Hyperface: a deep multi-task learning framework for face detection, landmark localization, pose estimation, and gender recognition.IEEE反式。模式肛门。机器英特尔。gydF4y2Ba41岁,121 - 135。doi: 10.1109 / TPAMI.2017.2781233gydF4y2Ba

《公共医学图书馆摘要》gydF4y2Ba|gydF4y2BaCrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Sirohey, S。,Ro年代enfeld,一个。,Duric z (2002)。 A method of detecting and tracking irises and eyelids in video.Recog模式。gydF4y2Ba35岁,1389 - 1401。doi: 10.1016 / s0031 - 3203 (01) 00116 - 9gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

太阳,Y。,W一个ng,X., and Tang, X. (2013a). “Deep convolutional network cascade for facial point detection,” in《IEEE计算机视觉与模式识别会议(CVPR)gydF4y2Ba(波特兰,或),3476 - 3483。doi: 10.1109 / CVPR.2013.446gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

太阳,Y。,Zafeiriou, S., and Pantic, M. (2013b). “A hybrid system for on-line blink detection,” in国际会议系统科学gydF4y2Ba(夏威夷,你好)。gydF4y2Ba

棕褐色,H。,和Zhang, Y. J. (2006). Detecting eye blink states by tracking iris and eyelids.Recog模式。列托人。gydF4y2Ba27日,667 - 675。doi: 10.1016 / j.patrec.2005.10.005gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba谷歌学术搜索gydF4y2Ba

Vezzetti E。,米一个rcolin, F., Tornincasa, S., and Maroso, P. (2016) Application of geometry to RGB images for facial landmark localization - a preliminary approach.Int。j .生物识别技术gydF4y2Ba8 216 - 236。doi: 10.1504 / IJBM.2016.082597gydF4y2Ba

CrossRef全文gydF4y2Ba|gydF4y2Ba

思远陈gydF4y2Ba

思远陈gydF4y2Ba 朱利安EppsgydF4y2Ba

朱利安EppsgydF4y2Ba